Die Vorlage File Validation ist ein hochflexibles und konfigurierbares Framework, das den Import und die Validierung von Datendateien mit beliebigen oder heterogenen Strukturen optimieren soll. Es unterstützt die Anpassung von Validierungsregeln und -verhaltensweisen auf der Grundlage von organisatorischen Anforderungen, Datenstandards und Qualitätserwartungen. Dies ermöglicht es sowohl technischen als auch geschäftlichen Anwendern, die Integrität und Konsistenz von Daten sicherzustellen, bevor sie verarbeitet oder in Kernsysteme integriert werden.

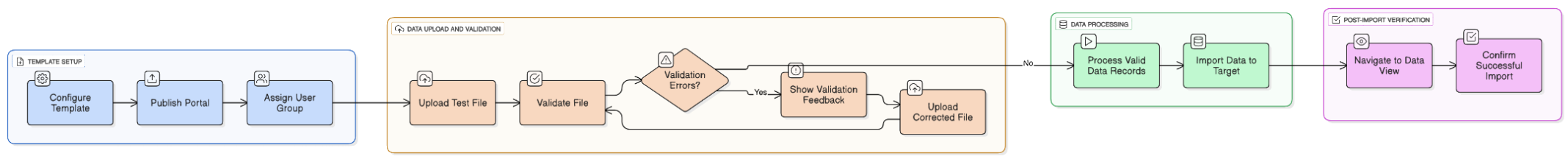

Flussdiagramm zur Veranschaulichung der Schritte für Daten-Upload, -Validierung und -Verarbeitung

Bereitstellung und Einrichtung

Der Einrichtungsprozess erfordert keine manuelle Backend-Konfiguration, was eine schnelle Einführung und den sofortigen Einsatz in Testszenarien ermöglicht.

Voraussetzungen

Sie benötigen zur Installation eine Rolle mit den erforderlichen Berechtigungen.

HINWEIS Wenn der ausführende Benutzer diese Berechtigung nicht besitzt, wird die Installation der Vorlage abgebrochen.

Installation

Sie können die Dateivalidierungsvorlage über die Systemschnittstelle bereitstellen.

Navigieren Sie zu Verwaltung → Mit Vorlage starten.

Klicken Sie in der Kachel File Validation auf Installieren.

Nach Abschluss der Installation steht die Vorlage unter Data Platform → Orchestration → Portale unter dem Namen „Template File Validation“ bereit.

Schlüsselkomponenten

Die Vorlage ist in drei Kernschnittstellenbereiche unterteilt, die jeweils einem bestimmten Zweck dienen:

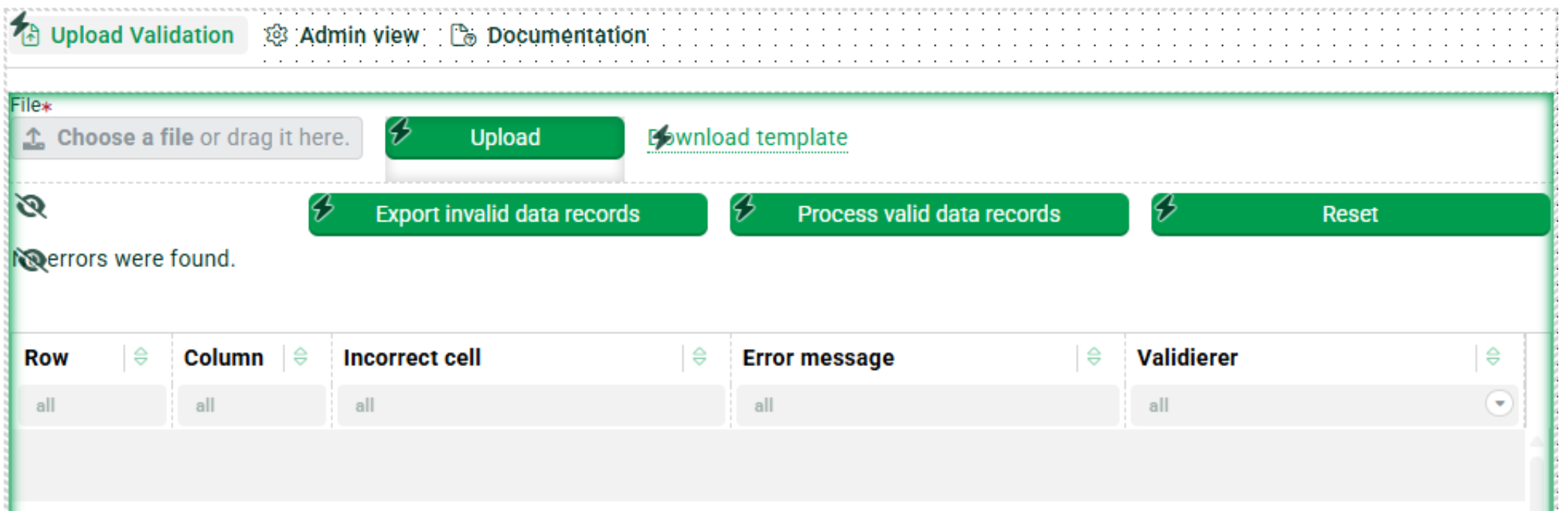

Upload Validation

Enthält die für Datei-Uploads erforderlichen Front-End-UI-Elemente und zeigt dem Endbenutzer die Validierungsergebnisse an. Dies ist der zentrale Einstiegspunkt für alle, die Daten übermitteln möchten.

Schnittstelle für den Datei-Upload, die Optionen zum Hochladen von Dateien und Fehlermeldungen für Datensätze anzeigt.

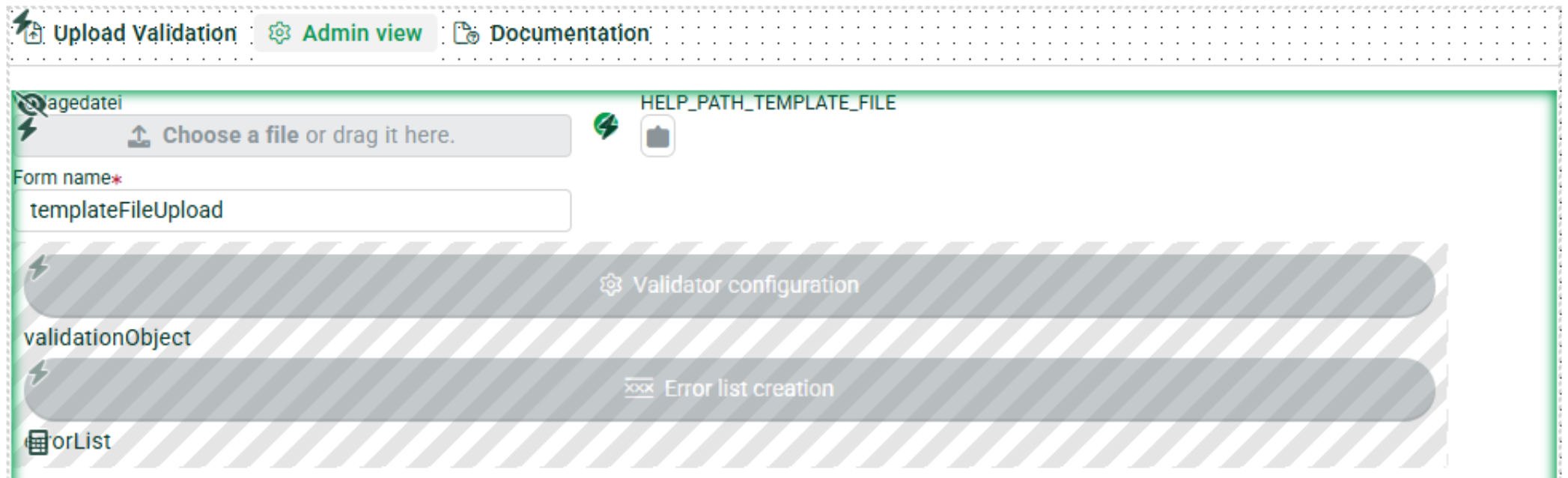

Admin View

Bietet Funktionen zum Hochladen und Verwalten von Validierungskonfigurationen, Strukturprofilen und Verhaltensregeln. Dieser Abschnitt wird in der Regel von Administratoren oder Datenverantwortlichen genutzt, um festzulegen, wie eingehende Daten verarbeitet werden sollen.

Admin View-Ansicht

Documentation-Tab

Verweist auf diese Seite mit Nutzungshinweisen und Konfigurationsrichtlinien.

Konfigurations-Workflow

Das Template ermöglicht einen modularen, nutzerzentrierten Konfigurationsansatz:

Profil-Anpassung

Nutzer definieren die erwartete Quell- und Zieldatenstruktur – einschließlich Datentypen, Pflichtfeldern und relationalen Mappings. Diese Profile dienen der Validierungs-Engine als Blaupause zur korrekten Interpretation eingehender Daten.

Validierungsregeln

Vordefinierte Beispielprofile wie CheckColumnType veranschaulichen die Validierung von Datentypen, Feldpräsenz oder fachlichen Regeln. Diese Validierungen lassen sich für Datensätze wie Produktkataloge, Kundendaten oder Transaktionsdaten erweitern und anpassen.

Verhaltensbasierte Validierung via Portal-Logik

Erweiterte Validierungen lassen sich über Portal-Behaviors definieren, die clientseitige Workflows zur dynamischen Regelausführung nutzen. Ein Behavior wie Check-Required-Fields prüft z. B. jeden Datensatz der hochgeladenen Datei und protokolliert Validierungsfehler bei fehlenden Werten. Diese Behaviors können um Schleifen, bedingte Logik oder benutzerdefinierte Fehlermeldungen ergänzt werden.

End-to-End-Beispiel-Workflow

Der folgende Schritt-für-Schritt-Prozess veranschaulicht einen typischen Anwendungsfall:

Template-Veröffentlichung

Nach der Konfiguration publizieren Sie das Portal und weisen es einer bestimmten Benutzergruppe zu. Dies ermöglicht Access Control und rollenspezifische Datenvalidierung.

Test-Datei-Upload

Eine Beispieldatei wird über das Benutzerinterface hochgeladen. Das System verarbeitet die Datei unmittelbar und gibt Validierungs-Feedback aus. Fehler wie fehlende Felder, ungültige Datentypen oder Out-of-Range-Werte werden aufgelistet.

Datenverarbeitung

Nach abgeschlossener Validierung kann der Nutzer den Import aller validen Datensätze über die Funktion Process Valid Data Records anstoßen. Die validierten Daten werden in das konfigurierte Zielobjekt oder den Datenspeicher importiert, der vorab eingerichtet sein muss.

Verifikation

Nach dem Import können Sie in der Datenansicht für eine schnelle Qualitäts- und Integritätskontrolle anhand von Zeitstempeln oder Record Counts die erfolgreiche Übernahme prüfen.

Vorteile

Hochgradig anpassbar: Flexibel einsetzbar für ein breites Spektrum an Datenformaten, Schemata und fachlichen Domänen – geeignet für strukturierte und semi-strukturierte Datenquellen.

Echtzeit-Validierungsfeedback: Liefert sofortige Einblicke in Datenqualitätsprobleme und ermöglicht korrigierende Maßnahmen noch vor dem Import.

Nahtlose Integration: Fügt sich in bestehende Data-Management- und Portal-Umgebungen ein, ohne vorhandene Workflows zu beeinträchtigen.

Behavioral Control und Access Management: Unterstützt Custom Behaviors und granulares Berechtigungsmanagement, um Validierungslogik an Geschäftsrollen auszurichten.

Low-Code-Konfigurierbarkeit: Viele Aspekte sind per UI oder JSON-basierten Profilen konfigurierbar – ohne tiefgreifende Programmierkenntnisse. Ideal für schnelles Deployment und agile Iteration.

Wiederverwendbare Validierungslogik: Einmal erstellte Profile und Regeln lassen sich über mehrere Portale und Abteilungen hinweg wiederverwenden und gewährleisten so konsistente Standards in der gesamten Organisation.

Fazit

Das Template bildet eine robuste Grundlage für standardisierte, wiederverwendbare und nutzerfreundliche Datenvalidierungsprozesse. Es versetzt Organisationen in die Lage, Data Quality Assurance frühzeitig in die Datenpipeline zu verlagern, mit dem Ergebnis: weniger Downstream-Fehler, höhere Reporting-Genauigkeit und nachhaltige Compliance mit internen wie externen Datenstandards. Ob IT, Data Governance oder Business-Stakeholder, diese Lösung steigert die Zuverlässigkeit und Transparenz im gesamten Daten-Handling.